Was ist ein Quantencomputer – Funktionsweise, Anwendungen und Ausblick

Die Idee stammt aus den 1980er-Jahren: Richard Feynman stellte die Frage, ob sich die Natur mit Mitteln der Quantenmechanik simulieren lasse. Die Antwort darauf ist der Quantencomputer – ein Rechensystem, das Informationen nicht wie herkömmliche Rechner verarbeitet, sondern die Regeln der Quantenphysik nutzt, um bestimmte Probleme exponentiell schneller zu lösen.

Im Kern basieren Quantencomputer auf Qubits, Superposition und Verschränkung. Diese drei Konzepte ermöglichen es, dass ein Quantencomputer nicht nur einen Berechnungsweg gleichzeitig verfolgt, sondern alle möglichen Wege parallel. Für Aufgaben wie die Faktorisierung großer Zahlen oder die Simulation molekularer Strukturen wäre das ein Paradigmenwechsel. Gleichzeitig steht die Technologie vor erheblichen Herausforderungen: Dekohärenz, Fehleranfälligkeit und die Skalierung auf praxistaugliche Systeme.

Dieser Artikel erklärt, was ein Quantencomputer ist, wie er funktioniert, welche Unternehmen die Entwicklung vorantreiben und wann mit einer praktischen Einsetzbarkeit zu rechnen ist.

Was ist ein Quantencomputer?

Ein Quantencomputer ist ein Rechner, der auf den Prinzipien der Quantenmechanik basiert. Im Gegensatz zu klassischen Computern, die mit Bits arbeiten, die entweder den Zustand 0 oder 1 einnehmen, nutzen Quantencomputer Qubits. Diese Quantenbits können durch das Prinzip der Superposition mehrere Zustände gleichzeitig einnehmen. Zusätzlich sorgt die Verschränkung dafür, dass Qubits miteinander korreliert werden, sodass der Zustand eines Qubits den eines anderen instantan beeinflusst.

Diese beiden Phänomene zusammen erzeugen den sogenannten Quantenparallelismus: Ein einzelnes Quantengatter wirkt auf alle möglichen Eingaben gleichzeitig. Während ein klassischer Computer für n Bits n Verarbeitungsschritte benötigt, kann ein Quantensystem mit n Qubits theoretisch 2ⁿ Zustände parallel bearbeiten. Das macht Quantencomputer bei bestimmten mathematischen und physikalischen Fragestellungen ungleich leistungsfähiger als konventionelle Systeme.

Definition

Ein auf Quantenmechanik basierendes Rechensystem, das Qubits statt klassischer Bits verwendet.

Kernprinzipien

Qubits, Superposition und Verschränkung bilden die Grundlage für parallele Berechnungen.

Vergleich klassisch

Klassische Computer verarbeiten sequentiell, Quantensysteme parallel mit exponentieller Skalierung.

Status 2025

Prototypen mit Hunderten bis über tausend Qubits in der Erprobung; vollständig fehlertolerante Systeme noch in Entwicklung.

Wichtige Erkenntnisse auf einen Blick

- Quantencomputer nutzen Qubits statt klassischer Bits, was die gleichzeitige Verarbeitung mehrerer Zustände ermöglicht.

- Mit n Qubits lassen sich 2ⁿ Zustände gleichzeitig bearbeiten – ein exponentieller Vorteil gegenüber klassischen Systemen.

- Verschränkte Qubits ermöglichen korrelierte Verarbeitung, unabhängig von der räumlichen Entfernung.

- Praktische Anwendungen umfassen Molekülsimulationen, Kryptographie und Optimierungsprobleme.

- Die Technologie befindet sich in der Entwicklungsphase; vollständig skalierbare Systeme werden um 2030 erwartet.

- Unternehmen wie IBM, Google und Rigetti betreiben aktive Forschung und bieten Cloud-Zugang zu Quantensystemen.

| Fakt | Details |

|---|---|

| Erste konzeptionelle Idee | Richard Feynman, 1982 |

| Grundlegende Informationseinheit | Qubit (Quantenbit) |

| Superposition | Gleichzeitige Existenz in mehreren Zuständen |

| Verschränkung | Instantane Korrelation zwischen Qubits |

| Quanten-Supremacy demonstriert | Google, 2019, Sycamore-Prozessor |

| Aktuelle Qubit-Zahlen | IBM über 1000 Qubits (2023–2025) |

| Erwartete Vollskalierung | Circa 2030 |

| Erste NISQ-Anwendungen | 2025–2027 prognostiziert |

Wie funktioniert ein Quantencomputer?

Qubits: Die Grundlage der Quanteninformatik

Die kleinste Informationseinheit in einem klassischen Computer ist das Bit – es existiert entweder als 0 oder als 1. Ein Qubit hingegen kann durch Superposition beide Zustände gleichzeitig einnehmen. In der mathematischen Notation wird ein Qubit-Zustand als Überlagerung dargestellt: |ψ⟩ = α|0⟩ + β|1⟩. Dabei sind α und β komplexe Amplituden, deren Quadrate die Wahrscheinlichkeiten für die Zustände 0 und 1 bei einer Messung angeben. Die Normierungsbedingung |α|² + |β|² = 1 stellt sicher, dass die Gesamtwahrscheinlichkeit eins ergibt.

Diese Zustände sind nicht physisch als 0 oder 1 zu verstehen, sondern als Wahrscheinlichkeitsamplituden. Erst bei der Messung kollabiert der Superpositionszustand in einen der beiden Basiszustände. Die konkreten Wahrscheinlichkeiten ergeben sich aus den Amplituden α und β.

Superposition und Quantenparallelismus

Superposition bedeutet, dass ein Qubit so präpariert werden kann, dass es sich gleichzeitig in verschiedenen Zuständen befindet. Werden mehrere Qubits in Superposition versetzt, steigt die Anzahl der gleichzeitig verarbeitbaren Zustände exponential an. Mit n Qubits lassen sich 2ⁿ Zustände parallel darstellen. Das ist der Grund, warum bereits ein System mit wenigen Dutzend Qubits Berechnungen durchführen kann, für die klassische Supercomputer Jahre bräuchten.

Ein einzelnes Quantengatter, also eine elementare Operation auf Qubits, wirkt dabei nicht nur auf einen Eingabezustand, sondern auf alle überlagerten Zustände gleichzeitig. Diese parallele Verarbeitung ist der Kern des Quantenvorteils.

Verschränkung: Der Schlüssel zur korrelierten Verarbeitung

Verschränkung (Entanglement) koppelt zwei oder mehr Qubits so, dass der Quantenzustand eines Qubits nicht unabhängig von den anderen beschrieben werden kann. Ändert sich der Zustand eines verschränkten Qubits, beeinflusst das instantan den Zustand des anderen – und zwar unabhängig von der Entfernung zwischen ihnen. Albert Einstein bezeichnete dieses Phänomen einst als „spukhafte Fernwirkung”.

Verschränkte Qubits ermöglichen es, Informationen auf korrelierte Weise zu verarbeiten. Das ist besonders wichtig für Algorithmen, die mehrdimensionale Zusammenhänge abbilden müssen, etwa bei der Simulation molekularer Wechselwirkungen oder bei Optimierungsaufgaben.

Die Messung eines Qubits zerstört seinen Superpositionszustand – er kollabiert unwiderruflich in einen Basiszustand. Dieser fundamentale Umstand begrenzt, wie lange Berechnungen aufrechterhalten werden können. Zusätzlich sorgt Dekohärenz dafür, dass Quantenzustände durch Umwelteinflüsse wie Temperaturschwankungen, Vibrationen oder elektromagnetische Strahlung verändert werden. Stabile Qubits erfordern daher extrem niedrige Temperaturen nahe dem absoluten Nullpunkt und präzise Isolation von der Umwelt.

Unterschied zwischen Quantencomputer und normalem Computer

Verarbeitung von Informationen

Der fundamentale Unterschied liegt in der Art, wie Informationen verarbeitet werden. Ein klassischer Computer arbeitet sequentiell: Ein Bit nimmt zu jedem Zeitpunkt genau einen Zustand ein, und Berechnungen erfolgen Schritt für Schritt. Für n Bits werden n Verarbeitungsschritte benötigt.

Ein Quantencomputer hingegen nutzt die Superposition, um alle möglichen Zustände gleichzeitig zu repräsentieren. Mit n Qubits können 2ⁿ Zustände parallel verarbeitet werden. Diese exponentielle Parallelität ist der Grund, warum Quantensysteme bei bestimmten Problemen klassischen Rechnern weit überlegen sind.

Einsatzgebiete und Stärken

Klassische Computer eignen sich hervorragend für alltägliche Aufgaben: Textverarbeitung, Webbrowsing, Datenbankabfragen und strukturierte Berechnungen. Sie arbeiten zuverlässig, sind robust und können einfach skaliert werden, indem mehr Transistoren auf einen Chip integriert werden.

Quantencomputer sind hingegen für spezifische Problemklassen konzipiert, bei denen die gleichzeitige Exploration vieler Lösungswege entscheidend ist. Dazu gehören die Faktorisierung großer Zahlen (relevant für Kryptographie), die Simulation quantenmechanischer Systeme (relevant für Pharmazie und Materialwissenschaft) sowie komplexe Optimierungsaufgaben. Für weiterführende Informationen zu verwandten Technologiethemen empfiehlt sich ein Blick auf Künstliche Intelligenz.

| Aspekt | Klassischer Computer | Quantencomputer |

|---|---|---|

| Informationseinheit | Bit: Nur 0 oder 1 | Qubit: Superposition von 0 und 1 |

| Verarbeitung | Sequentiell, ein Berechnungspfad pro Schritt | Parallel: 2ⁿ Zustände gleichzeitig |

| Fehleranfälligkeit | Gering, durch etablierte Fehlerkorrektur | Hoch, durch Dekohärenz und Messung |

| Skalierung | Linear durch mehr Transistoren | Exponentiell durch mehr Qubits |

| Stärken | Zuverlässig für Alltagsaufgaben | Überlegen bei Optimierung, Simulationen, Kryptographie |

| Verfügbarkeit | Breit verfügbar seit Jahrzehnten | Prototypen, Cloud-Zugang für Forschung |

Welche Anwendungen haben Quantencomputer?

Simulation quantenmechanischer Systeme

Eine der vielversprechendsten Anwendungen ist die Simulation von Molekülen und Materialien auf quantenphysikalischer Ebene. Herkömmliche Computer stoßen hier schnell an ihre Grenzen, da die Anzahl der möglichen Zustände selbst bei einfachen Molekülen enorm ist. Ein Quantensystem kann diese Zustände naturgemäß besser abbilden, weil es selbst nach quantenmechanischen Regeln funktioniert.

Dadurch eröffnen sich Möglichkeiten in der Arzneimittelforschung: Wirkstoffe könnten am Computer mit atomarer Präzision simuliert werden, um ihre Wechselwirkungen mit biologischen Strukturen vorherzusagen, bevor teure Laborversuche nötig werden.

Kryptographie und Sicherheit

Quantencomputer können bestimmte kryptographische Verfahren bedrohen, insbesondere die RSA-Verschlüsselung, die auf der Schwierigkeit der Primfaktorzerlegung großer Zahlen basiert. Peter Shors Algorithmus aus dem Jahr 1994 zeigte theoretisch, dass ein hinreichend leistungsfähiger Quantencomputer diese Probleme in polynomieller Zeit lösen könnte.

Gleichzeitig ermöglicht die Quantenmechanik neue Sicherheitskonzepte wie die Quantenschlüsselverteilung, die theoretisch abhörsicher sein soll. Die Entwicklung quantenresistenter Verschlüsselungsverfahren ist daher ein aktives Forschungsfeld.

Optimierung und maschinelles Lernen

Komplexe Optimierungsprobleme – etwa die Routenplanung für Logistikunternehmen oder die Portfoliosteuerung im Finanzwesen – könnten von Quantenalgorithmen profitieren. Probleme mit sehr vielen Variablen und Randbedingungen lassen sich auf Quantensystemen potenziell schneller lösen als auf klassischen Rechnern.

Im Bereich des maschinellen Lernens wird erforscht, wie Quantencomputer die Verarbeitung hochdimensionaler Datensätze beschleunigen können. Erste Algorithmen wie der Quantum Approximate Optimization Algorithm (QAOA) werden bereits auf aktuellen NISQ-Systemen (Noisy Intermediate-Scale Quantum) getestet.

Quantencomputer eignen sich besonders für Probleme, bei denen viele Lösungspfade gleichzeitig exploriert werden müssen. Dazu zählen Molekülsimulationen, Kryptographie, komplexe Optimierungsaufgaben und die Suche in unstrukturierten Daten. Für alltägliche Aufgaben wie Textverarbeitung oder Webbrowsing bieten klassische Computer weiterhin die praktischere Lösung.

Sind Quantencomputer schon verfügbar?

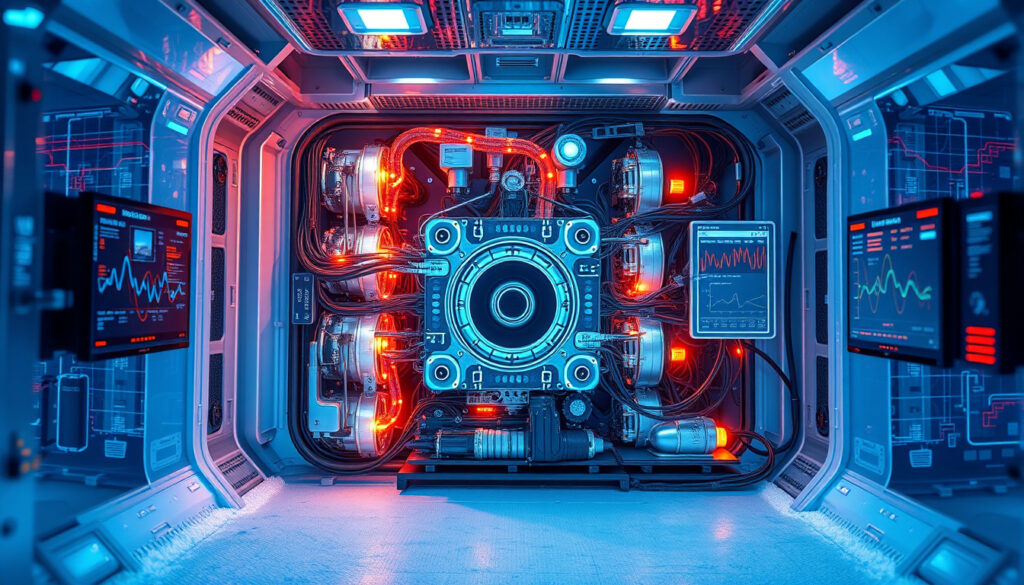

Unternehmen und Prototypen

Die Technologie befindet sich in einem frühen Entwicklungsstadium. Unternehmen wie IBM, Google und Rigetti entwickeln aktive Prototypen. IBM bietet bereits Cloud-Zugang zu Quantensystemen mit Hunderten von Qubits an. Über die IBM Quantum Platform können Forscher und Entwickler Algorithmen auf realen Quantencomputern testen, ohne selbst Hardware besitzen zu müssen.

Google demonstrierte 2019 mit dem Sycamore-Prozessor die sogenannte Quanten-Supremacy: Innerhalb von 200 Sekunden löste das System eine spezifische Aufgabe, für die klassische Supercomputer schätzungsweise 10.000 Jahre benötigt hätten. Dieser Meilenstein zeigte, dass Quantensysteme für bestimmte Berechnungen tatsächlich schneller sein können als konventionelle Rechner.

Herausforderungen und Fehlerkorrektur

Trotz der Fortschritte stehen Quantencomputer vor erheblichen technischen Hürden. Die empfindlichen Qubits reagieren extrem sensibel auf Umwelteinflüsse. Stabile Systeme erfordern Temperaturen nahe dem absoluten Nullpunkt (etwa -273 Grad Celsius) und aufwendige Abschirmung gegen Vibrationen und elektromagnetische Strahlung.

Die Fehlerkorrektur stellt eine besondere Herausforderung dar. Quantenfehlerkorrekturcodes kodieren ein einzelnes logisches Qubit in vielen physischen Qubits, um Fehler zu erkennen und zu korrigieren. Aktuelle Schätzungen gehen davon aus, dass für ein einziges vollwertiges logisches Qubit mehrere tausend physische Qubits benötigt werden. Das macht den Bau skalierbarer Quantencomputer zu einem technisch und wirtschaftlich anspruchsvollen Unterfangen.

Ausblick: Wann sind Quantencomputer praxistauglich?

Die sogenannte NISQ-Ära (Noisy Intermediate-Scale Quantum) hat bereits begonnen. Zwischen 2025 und 2027 werden erste praktische Anwendungen erwartet, die spezifische Aufgaben auf Quantensystemen effizienter lösen als klassische Computer. Diese Systeme arbeiten noch mit Fehlern, sind aber für eng begrenzte Probleme bereits nutzbar.

Vollständig fehlertolerante Quantencomputer mit umfassender Fehlerkorrektur werden frühestens um 2030 erwartet. Erst dann könnten die vielzitierten Vorteile des Quantencomputings – Faktorisierung großer Zahlen, komplexe Molekülsimulationen, umfassende Optimierungen – zuverlässig und in industriellem Maßstab genutzt werden.

Die größte technische Hürde bleibt die Dekohärenz: Quantenzustände zerfallen innerhalb kürzester Zeit, was fehlerhafte Berechnungen zur Folge hat. Während aktuelle Systeme einige hundert bis tausend Qubits aufweisen, sind für praktisch relevante Anwendungen vermutlich Millionen stabiler Qubits erforderlich. Wann diese Skalierung gelingt, bleibt gegenwärtig unklar.

Chronologie: Meilensteine des Quantencomputings

Die Entwicklung des Quantencomputings lässt sich anhand mehrerer Schlüsselereignisse nachvollziehen. Von der theoretischen Grundlegung bis zu aktuellen Prototypen zeigt die Timeline, wie sich die Technologie von einem physikalischen Konzept zu einem Ingenieurprojekt gewandelt hat.

- 1982: Richard Feynman präsentiert die Idee, Natur mit quantenmechanischen Mitteln zu simulieren.

- 1994: Peter Shor entwickelt einen Algorithmus zur Faktorisierung großer Zahlen, der auf Quantensystemen laufen könnte.

- 2001: Erste experimentelle Demonstration des Shor-Algorithmus mit 7 Qubits.

- 2016: IBM startet den IBM Quantum Experience, einen Cloud-Zugang zu Quantensystemen.

- 2019: Google demonstriert Quanten-Supremacy mit dem Sycamore-Prozessor.

- 2021: IBM erreicht 127 Qubits mit dem Eagle-Prozessor.

- 2023: IBM überschreitet 1000 Qubits; Fehlerkorrekturmethoden werden verbessert.

- 2025–2027: Erste NISQ-Anwendungen für spezifische Problemstellungen erwartet.

- Circa 2030: Vollständig fehlertolerante Quantencomputer prognostiziert.

Was ist sicher – und was bleibt unklar?

Die Grundprinzipien des Quantencomputings – Superposition, Verschränkung und Quantenparallelismus – sind wissenschaftlich gut verstanden. Die zugrundeliegende Mathematik und Physik wurden in zahlreichen Experimenten bestätigt. Ebenso ist die grundlegende Überlegenheit von Quantensystemen für bestimmte Aufgaben durch die Demonstration der Quanten-Supremacy belegt.

Unklarheiten bestehen hingegen bei der praktischen Skalierbarkeit. Es ist nicht absehbar, wann hinreichend viele stabile Qubits für industrielle Anwendungen zur Verfügung stehen. Die Zeitrahmen für vollständig fehlertolerante Systeme beruhen auf Schätzungen und könnten sich sowohl verkürzen als auch verlängern.

| Bereich | Abgesicherte Erkenntnisse | Verbleibende Unsicherheiten |

|---|---|---|

| Physikalische Prinzipien | Superposition und Verschränkung experimentell bestätigt | Keine |

| Algorithmen | Shor, Grover und andere Algorithmen theoretisch ausgereift | Praktische Implementierung auf fehlerbehafteten Systemen unklar |

| Hardware-Entwicklung | Prototypen mit Hunderten bis über 1000 Qubits existieren | Zeitrahmen für Skalierung auf Millionen Qubits unsicher |

| Fehlerkorrektur | Grundlegende Verfahren etabliert | Effiziente Umsetzung mit vertretbarem Hardware-Aufwand offen |

| Anwendungen | Theoretische Vorteile für spezifische Problemklassen nachgewiesen | Konkrete praktische Durchbrüche und Zeitrahmen ungewiss |

Hintergrund und Bedeutung

Quantencomputer repräsentieren einen fundamentalen Paradigmenwechsel in der Informatik. Während klassische Rechner seit Jahrzehnten nach dem Mooreschen Gesetz skaliert wurden – mehr Transistoren auf kleinerem Raum – stoßen herkömmliche Siliziumsysteme zunehmend an physikalische Grenzen. Die Miniaturisierung der Transistoren nähert sich der atomaren Skala, bei der quantenmechanische Effekte nicht mehr vernachlässigt werden können.

Das Quantencomputing nutzt diese Effekte nicht als Problem, sondern als Grundlage für eine neue Rechenarchitektur. Dieser Ansatz hat das Potenzial, nicht nur bestehende Computer zu verbessern, sondern völlig neue Problemklassen zu erschließen. Die Auswirkungen könnten Bereiche von der Pharmazie über die Finanzwirtschaft bis hin zur Cybersicherheit grundlegend verändern.

Gleichzeitig ist die Entwicklung mit erheblichen Risiken verbunden. Die Fähigkeit, aktuelle Verschlüsselungsverfahren zu brechen, könnte Sicherheitsinfrastrukturen weltweit bedrohen. Regierungen und Unternehmen investieren daher massiv in beide Richtungen: in die Entwicklung von Quantencomputern und in quantenresistente Kryptographie.

Quellen und Expertenmeinungen

Die wissenschaftliche Grundlage des Quantencomputings stützt sich auf jahrzehntelange Forschung in der Quantenphysik und Informatik. Zentrale Fachpublikationen und institutionsübergreifende Zusammenarbeit prägen das Feld.

„Nature isn’t classical, and if you want to make a simulation of nature, you’d better make it quantum mechanical.”

Richard Feynman, 1981

Feynmans These aus dem Jahr 1981 gilt als Initialzündung für das Quantencomputing. Er erkannte, dass klassische Computer bei der Simulation quantenmechanischer Systeme an prinzipielle Grenzen stoßen – und schlug vor, diese mit Mitteln der Quantenmechanik selbst zu simulieren.

Aktuelle Entwicklungen werden maßgeblich von Technologieunternehmen vorangetrieben. IBM veröffentlicht regelmäßig Fortschrittsberichte zu Qubit-Zahlen und Fehlerkorrekturmethoden. Die Physikalisch-Technische Bundesanstalt erforscht in Deutschland die metrologischen Grundlagen für Quantentechnologien. Die Forschungsgemeinschaft publiziert Ergebnisse in Fachzeitschriften wie Nature und betreibt mit der Wikipedia öffentlich zugängliche Wissenssammlungen.

Zusammenfassung

Ein Quantencomputer nutzt die Prinzipien der Quantenmechanik, um Berechnungen durchzuführen, die für klassische Systeme unmöglich oder extrem zeitaufwendig wären. Qubits, Superposition und Verschränkung ermöglichen die parallele Verarbeitung von 2ⁿ Zuständen mit n Qubits. Anwendungen reichen von der Molekülsimulation über die Kryptographie bis zur Optimierung komplexer Systeme.

Die Technologie steckt trotz bedeutender Fortschritte weiterhin in der Entwicklungsphase. Unternehmen wie IBM und Google betreiben Prototypen, aber vollständig fehlertolerante Systeme werden frühestens um 2030 erwartet. Für alltägliche Aufgaben bleiben klassische Computer die praktische Wahl – doch in spezialisierten Bereichen könnte das Quantencomputing die Grenzen des Machbaren verschieben. Wer die Entwicklung verfolgen möchte, kann Cloud-Dienste wie IBM Quantum nutzen und auf KI-Bilder Erstellen Online weiterführende Informationen zu verwandten Technologiethemen finden.

Häufig gestellte Fragen

Was sind die größten Herausforderungen beim Quantencomputing?

Dekohärenz zerstört Quantenzustände durch Umwelteinflüsse. Fehlerkorrektur erfordert tausende physische Qubits pro logischem Qubit. Stabile Systeme brauchen Temperaturen nahe dem absoluten Nullpunkt.

Wer entwickelt Quantencomputer?

IBM, Google und Rigetti führen die Entwicklung an. IBM bietet Cloud-Zugang zu Quantensystemen. Die Physikalisch-Technische Bundesanstalt erforscht in Deutschland metrologische Grundlagen.

Wann werden Quantencomputer praktisch einsetzbar sein?

Erste NISQ-Anwendungen werden für 2025–2027 erwartet. Vollständig fehlertolerante Systeme mit voller Fehlerkorrektur sind frühestens um 2030 absehbar.

Was ist der Unterschied zwischen Qubits und klassischen Bits?

Ein klassisches Bit ist entweder 0 oder 1. Ein Qubit kann durch Superposition beide Zustände gleichzeitig einnehmen und wird durch komplexe Amplituden beschrieben.

Was bedeutet Quanten-Supremacy?

Quanten-Supremacy bezeichnet den Punkt, an dem ein Quantencomputer eine Aufgabe schneller löst als jeder klassische Supercomputer es könnte. Google demonstrierte dies 2019 mit dem Sycamore-Prozessor.

Sind Quantencomputer eine Bedrohung für aktuelle Verschlüsselung?

Theoretisch ja: Hinreichend leistungsfähige Quantencomputer könnten RSA-Verschlüsselung brechen. Quantenresistente Kryptographie wird daher bereits entwickelt, um diese Gefahr abzuwehren.

Was ist NISQ-Computing?

NISQ steht für Noisy Intermediate-Scale Quantum. Es bezeichnet aktuelle Quantensysteme mit 50–1000 Qubits, die noch Fehler aufweisen, aber für spezifische Aufgaben bereits nutzbar sind.